Die Frage mutet zunächst absurd an: »Sollen Roboter mit Rechten ausgestattet oder geschützt werden?« Wenn man dann aber auf die Rechtsgeschichte zurückblickt, erkennt man, wie Paradigmenwechsel in der Zuteilung von Rechten immer wieder stattgefunden haben und zur Zeit undenkbar gewesen sind: Das Geschlecht, die Hautfarbe, die Abstammung und andere Gründe wurden vorgebracht, um Menschen Rechte zu verweigern, die ihnen nach heutigem Verständnis zustehen. Dasselbe gilt für Tiere: Tierrechte sind heute zwar weit gehend akzeptiert, gerade aber die Diskussion um Pferdefleisch zeigt, wie unklar die Vorstellungen in Bezug auf Tierrechte sind: In den USA dürfen Pferde nicht geschlachtet und gegessen werden, Rinder aber schon.

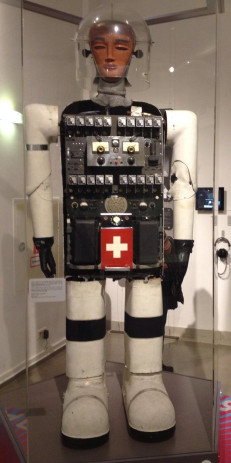

Diese Überlegung zeigt, dass man sich zumindest fragen kann, weshalb Robotern Rechte zugestanden werden könnten. Die Rede ist dabei von sozialen Robotern, also solchen mit physischer Präsenz und autonomer Handlungskompetenz, die in der Lage sind, auf einer emotionalen Ebene mit Menschen zu kommunizieren.

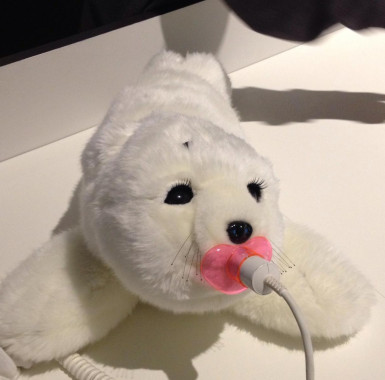

Solche Roboter gibt es immer mehr, sie können pädagogische, therapeutische und pflegerische Funktionen übernehmen. Beobachtet man die Reaktion von Menschen auf diese Roboter - ich beziehe mich hier wie im übrigen Beitrag auf ein Paper von Kate Darling - so stellt man Erstaunliches fest (S. 9 u. 14):

- Kinder können nicht mit Sicherheit sagen, ob Roboter Schmerzen oder Gefühle empfinden.

- Ältere Menschen können tierähnliche Roboter nicht von Tieren unterscheiden.

- Soziale Roboter werden aus Räumen entfernt, wenn sich Menschen ausziehen, sie schämen sich vor ihnen.

- Werden Roboter weggegeben, empfinden Menschen Verlustgefühle.

- Das »Misshandeln« von sozialen Robotern wird ähnlich wie das Misshandeln von Menschen oder Tieren von sadistischer Begeisterung und starkem Mitleid der Beobachtenden begleitet.

Damit wären wir bei den Gründen, warum man über Roboterrechte nachdenken könnte oder sollte:

- Schutz von menschlichen Gefühlen.

»Nurturing a machine that presents itself as dependent creates significant social attachment«, stellte Sherry Turkle fest. Ähnlich wie bei Tieren schützen wir nicht die Roboter selbst, sondern die mit ihnen verbundenen menschlichen Gefühle. - Rechte als pädagogische Formulierung von Normen

Darling stellt fest, dass Eltern Kinder dazu anhalten, Roboter nicht zu beschädigen. Nicht nur, weil die Geräte teuer sind, sondern weil sie ihnen auch Verhaltensweisen beibringen wollen, die im Umgang mit anderen Menschen wichtig sind. Das gilt auch für die Sexualmoral: Mit Robotern lassen sich sämtliche sexuellen Fantasien befriedigen. Werden hier Grenzen etabliert, so könnten diese dabei helfen, auch Menschen zu schützen. Rechte würden dann einfach festlegen, was Menschen mit anderen Lebewesen oder Objekten, mit denen sie emotional verbunden sind, nicht tun sollen. - Roboter könnten Gefühle und Schmerz empfinden.

Wir verstehen außerhalb unserer Wahrnehmung kaum, was es bedeutet, Gefühle oder Schmerz zu empfinden. Wir vollziehen diese Regungen bei anderen nur durch äußerliche Zeichen nach. Woher wissen wir, dass intelligente Roboter nicht auch Gefühle entwickeln oder etwas empfinden können, was dem menschlichen Schmerzempfinden gleichkommt?

Diese Frage stammt aus der Science Fiction, sie ist Gegenstand auch der Turing Tests, der besagt, dass Roboter dann denken können, wenn wir sie im Gespräch nicht von Menschen unterscheiden können. Etwas abstrahiert hieße das, wenn wir mit Robotern interagieren wie mit Menschen (oder Tieren), dann sollten sie auch entsprechende Rechte haben. - Menschliche Entwicklung.

Als die Tierrechtbewegung an Schwung aufnahm, wurde in der Zeit folgendes Argument entwickelt:Vor gerade einmal zwei Millionen Jahren turnten die unseligen Vorgänger der Menschengestalt noch als affenähnliche Wesen durch die Wälder. Zu welcher Form wird die Evolution den Menschen in den nächsten zwei Millionen Jahren bringen?

Menschen grenzen sich nicht klar von Tieren ab. Sie entwickeln sich. Dasselbe gilt auch für Roboter: Bald werden wir Google Glasses tragen, viele ältere Menschen tragen intelligente Hörgeräte, wir werden unsere Gelenke mit Automaten verbessern etc. Teile von unser werden Teile von Robotern sein. Hat ein künstliches Herz ein »Recht auf Leben« oder nur ein natürliches? Solche Fragen sind sehr schwierig und könnten durch Roboterrechte recht einfach gelöst werden.

Versucht man, ethisch zu argumentieren, kann man sich - wie Darling das tut - auf Kant beziehen: Kant sagte in einer Vorlesung, wenn ein Mann einen Hund erschieße, dann füge er nicht dem Hund Schaden zu, weil der Hund zu einem Urteil nicht in der Lage sei, sondern sich selbst, er verletze »die Menschlichkeit in sich«. Alternativ kann aber auch utilitaristisch argumentiert werden, insbesondere, sobald Roboter erkennbar Präferenzen angeben können.

* * *

Zur Auflockerung zwei Science-Fiction-Ausschnitte; zuerst der Turing-Test in Blade Runner (Ridley Scott, 1982), dann der Moment, in dem HAL 9000, der Computer in 2001 - A Space Odyssey (Stanley Kubrick, 1968) abgeschaltet wird und ein Lied aus seiner »Kindheit« singt: